Dünya’nın birinci “sertifikalı” deepfake görüntüsü: Her şey düzmece, söylenenler gerçek

Geçtiğimiz on yıllar boyunca çocuklara internette gördükleri her şeye inanmamaları söylendi. Ancak artık bu öğüdü yetişkinleri de kapsayacak formda genişletmemiz gerekiyor.

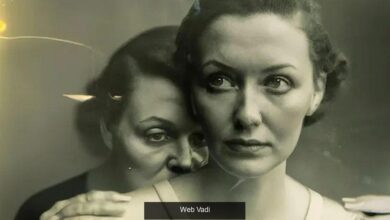

Yapay zeka (AI) teknolojisinin görüntüleri ve sesi gerçek hayatı taklit edecek halde manipüle etmek için kullanıldığı ve “deepfake” olarak isimlendirilen olaylar giderek daha fazla karşımıza çıkıyor. Ve artık, Dünya’nın birinci “sertifikalı” deepfake videosu, bir şeffaflık örneği oluşturmaya yardımcı olmak için AI stüdyosu Revel.ai tarafından yayınlandı.

Bu görüntüde, profesyonel bir AI danışmanı olan Nina Schick‘in “gerçek ile kurgu ortasındaki çizgilerin nasıl bulanıklaştığı” konusunda bir ikazda bulunduğu görülüyor. Lakin, yazının başlangıcından da iddia edebileceğiniz üzere, görüntüde görülen aslında gerçek Schick değil ve görüntü, dijital özgünlük şirketi Truepic tarafından kriptografik olarak imzalanarak yapay zeka tarafından üretilen içerik içerdiğini beyan ediyor.

Deepfake teknolojisi ile üretilen “sahte Schick” yavaş ve net bir formda, “Bazıları gerçeğin bizim gerçekliğimizin bir yansıması olduğunu söylüyor” diyor. Açıklamalar şöyle devam ediyor: “Onu kendi duyularımızla tanımlamaya alışkınız. Peki ya gerçekliğimiz değişiyorsa? Ya burada ve burada gördüklerimizin gerçekliğini belirlemek için artık duyularımıza güvenemezsek? Yapay zekanın şafağındayız ve gerçek ile kurgu ortasındaki çizgiler şimdiden bulanıklaşıyor. Gölgelerin gerçekle karıştırıldığı bir dünya ve bazen olayları gerçekte oldukları üzere görmek için bakış açımızı kökten değiştirmemiz gerekiyor. Bu deepfake, Revel.ai tarafından Nina Schick’in müsaadesiyle oluşturuldu ve Truepic tarafından kriptografik olarak imzalandı.”

- Deepfake nedir? Deepfake teknolojisi nasıl çalışıyor?

Porno görüntülerle ortaya çıktı

Deepfake’ler, ses, manzara yahut görüntüyü manipüle etmek için “derin öğrenmeyi” kullanan, hiper gerçekçi lakin düzmece medya içeriği oluşturan yapay zeka biçimleridir. Terim, 2017 yılında bir Reddit kullanıcısının foruma manipüle edilmiş porno görüntüler göndermesiyle ortaya çıktı.

Videolar, Gal Gadot, Taylor Swift ve Scarlett Johansson üzere ünlülerin yüzlerini müsaadeleri olmadan porno yıldızlarıyla değiştirmişti. Deepfake’in tehlikeli bir öbür örneği, geçtiğimiz yıl Rusya toplumsal medyasında geniş çapta dolaşan bir görüntüde Ukrayna cumhurbaşkanı Volodymyr Zelensky’nin Rusya’ya teslim olmuş üzere görünmesiyle ortaya çıktı. Cumhurbaşkanı, bu uydurma görüntüde Ukrayna askerlerini silahlarını bırakmaya ve Putin’in işgalci güçlerine boyun eğmeye çağırıyordu.

Dikkatli internet kullanıcıları Zelensky’nin boynunun ve yüzünün rengi, garip aksanı ve başının etrafındaki pikselleşme üzere tutarsızlıkları süratli bir halde bulsa da, bu görüntü birinci bakışta gereğince gerçekçi gözüküyordu.

Deepfake görüntüleri cümbüş emelli bir bedele sahip olabilse de, kimi uzmanlar oluşturabilecekleri tehlikeler konusunda yıllardır ikazlarda bulunuyor.

Pek çok uzman, bu deepfake görüntülerin prestij zedelemenin de ötesine geçerek ulusal düzeye kadar çıkabilecek önemli güvenlik tehlikeleri oluşturabileceğine ve “düşman faktörler” tarafından kendi gayeleri için kullanılabileceğine işaret ediyor.

DALL-E ve Meta’nın “Make-A-Video” üzere fiyatsız olarak kullanılabilen metinden imgeye ve metinden görüntüye yapay zeka araçlarının yükselişiyle, manipüle edilmiş medya daha yaygın hale gelecek üzere gözüküyor. Hatta, 2025 yılına kadar çevrimiçi içeriğin yüzde 90’ının yapay zeka kullanılarak üretileceği yahut oluşturulacağı varsayım ediliyor. Hasılı artık, internette gördüğümüz her şeye çok daha fazla kuşkuyla yaklaşmamız gerekebilir.